作为一款备受关注的先进语言模型,deepseek的对话最大支持轮次成为众多用户关心的重点话题。

从技术角度来看,对话轮次的限制受到多个因素的影响。首要的是内存容量的限制,随着对话的持续进行,模型需要保存越来越多的上下文信息,包括之前的会话内容、用户提出的问题以及系统的回复内容等。如果内存不足以承载如此庞大的数据量,就可能导致对话不连贯甚至出现错误。计算资源的有限也会影响支持的最大对话轮次,更长的交流需要耗费更多的计算能力,以确保回复的准确性和合理性。

在实际应用过程中,deepseek的最大对话轮次表现会因不同背景与场景而异。在一些日常闲聊场合,模型可能支持几十轮甚至上百轮的连续交互。在涉及复杂专业知识问答或深入探讨特定主题时,对话的轮次可能会相应减少。这主要是因为复杂场景对模型理解和推理的要求更高,每一次对话都需要更加细致的处理,从而限制了持续交流的轮次上限。

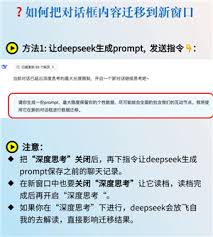

普通用户了解对话轮次的限制,有助于更合理地安排使用策略。如果只是进行一般性的闲谈,可以在接近对话上限时适当总结内容,开启新的话题。而专业人士在进行深度商务沟通或学术交流时,则需要提前规划对话流程,避免因超出上限而中断重要交流。

从开发者的角度来看,他们不断进行优化,以突破现有的对话轮次限制。通过改进内存管理机制、提升计算效率,力求让deepseek在保持高效和精准的支持更长时间、更丰富的对话内容。随着技术的持续推进,预计deepseek的对话轮次上限将逐步提升,旨在为用户带来更流畅、更连贯的交互体验,无论是在日常交流还是专业讨论中,都能实现更自然、更无缝的沟通。